«The World Inform» — это больше, чем обычная социальная сеть.

Хотя стандартные элементы соцсетей присутствуют: аккаунты, дружбы, группы, лайки, репосты, комментарии, статусы, stories и многое другое.

Основное внимание мы уделяем именно многофункциональности площадки. Цифровая экосистема будет дополняться новыми направлениями и улучшением комфорта.

Пользователи имеют возможность самостоятельно определить свою роль: они могут выступать как потребители контента, так и сами создавать его. Более того, каждый участник выбирает направление своей активности — личное или профессиональное, и форму подачи информации. Площадка предлагает широкий спектр форматов: от традиционных публикаций на стенах групп и профилей до современных удобных инструментов ведения блога, размещения вакансий и резюме, публикации объявлений, формирования плейлистов музыки, афиши. Помимо этого, предусмотрены обсуждения, голосования и рейтинговые системы, направленные на активное вовлечение аудитории и эффективную коммуникацию. По просьбе пользователей появились петиции.

Особое значение имеет взаимодействие в сфере политики и общественных инициатив. Уже сейчас многие представители власти, включая наиболее эффективных депутатов, сенаторов, госструктур, активно используют площадку для общения с населением и сбора обратной связи. Одна из ключевых составляющих эффективности является развитие информационного пространства и присутствия чиновников и организаций там, где присутствуют граждане. В этом плане МИД, МВД и Минпросвещение являются хорошими примерами. В противном случае это можно считать низким качеством работы пресс-служб и пиарщиков. Невозможно быть в повестке реальных проблем населения, если не присутствуете и не получаете реакцию общества. На WI власти на разных уровнях получают отклик (не всегда позитивный) от россиян, но это часть жизни.

Кроме того, мы реализовали качественный новостной агрегатор, предоставляющий актуальные материалы из авторитетных источников, благодаря чему пользователи получают полное представление о событиях, происходящих как в России, так и за её пределами.

Таким образом, говорить о том, что WI предназначен исключительно для деловых целей, было бы неверно. На площадке представлено значительное количество личного контента, а также обычные дружеские беседы и общение. Именно разнообразие возможностей и свобода выбора делают площадку привлекательной для самой широкой аудитории. К тому же, имеющийся и обновляющийся мессенджер позволяет людям общаться между собой лично.

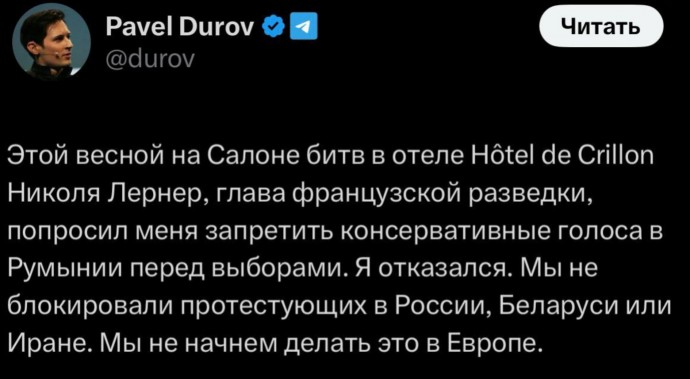

Для нас всегда главным являются безопасность персональных данных и свобода слова. Мы не запрашиваем и не отслеживаем никакие личные данные пользователей, и не ограничиваем выражение мнения на площадке. За исключением прямых оскорблений и травли. Не менее важным являются реакции реального общества, а не искусственные накрутки ботами. На WI модерация строго контролирует и отсекает эти попытки: поставленная оценка чиновникам и госструктурам, лайки, комментарии, посты, голосования и подписи, другие активности совершают реальные люди. Ежедневно на площадке всё больше россиян находят друзей и деловых партнеров, и получают полную информационную картину.

С уважением, руководство WI.